网络安全领域近期迎来了一项新的警示,一种被称作“Slopsquatting”的攻击手段正逐渐显露头角。这种攻击方式利用了生成式人工智能(AI),如大型语言模型(LLMs)在代码编写过程中可能引发的“包幻觉”现象。所谓的“包幻觉”,指的是AI在推荐软件包名称时,有时会生成并不存在的名称,而这些名称往往看起来十分逼真。

攻击者利用这一漏洞,预先注册了这些由AI虚构的软件包名称,并在其中植入了恶意代码。研究人员指出,这些由AI生成的虚构包名具有很高的可信度和重复性,约有38%的虚构包名与真实存在的包名高度相似,仅有13%的虚构包名是通过简单的拼写错误产生的。这种相似性使得开发者在未经核实的情况下,很容易直接采用这些包名。

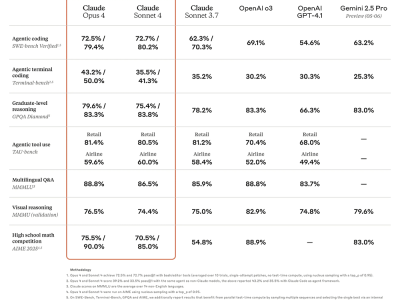

在对16个代码生成模型进行测试后,研究人员发现,平均有20%的AI推荐软件包是伪造的。尤其是开源模型,如DeepSeek和WizardCoder,它们的幻觉率高达21.7%。相比之下,商业模型如GPT-4Turbo的幻觉率则相对较低,为3.59%。而CodeLlama的表现最为糟糕,超过三分之一的推荐都存在错误。这种威胁在Python和Javascript等依赖中央包仓库的编程生态系统中尤为突出。

实验数据进一步显示,AI的“包幻觉”现象具有很高的可复现性。在高达43%的案例中,相同的幻觉会连续出现10次,而58%的幻觉会在多次测试中重复出现。这种高度的可复现性为攻击者提供了极大的便利,使他们能够精准地布局恶意软件包。

研究人员认为,当前AI模型在安全测试方面的不足是导致这一问题的主要原因。尽管目前尚未发现实际的Slopsquatting攻击案例,但该技术已经具备了构成现实威胁的所有要素。因此,研究人员强烈呼吁开发社区提高警惕,对AI生成的代码建议保持审慎态度,并务必进行验证,以免成为这种新型软件供应链攻击的受害者。