随着人工智能技术的飞速发展,AI的应用场景日益丰富,甚至开始渗透进交友软件领域。然而,在这一波技术浪潮中,一个名为“Prompt逐步失效”的现象逐渐浮出水面,引起了业界的广泛关注。

在大规模预训练模型不断更新迭代的背景下,生成式AI的应用变得越来越广泛。然而,许多用户发现,曾经那些精准有效的提示词,如今却似乎失去了魔力。无论是要求AI生成特定方案,还是进行创意设计,得到的回答往往变得模糊不清,缺乏条理,甚至充斥着模板化的套话。这种变化并非用户的错觉,而是AI正面临的一个潜在危机。

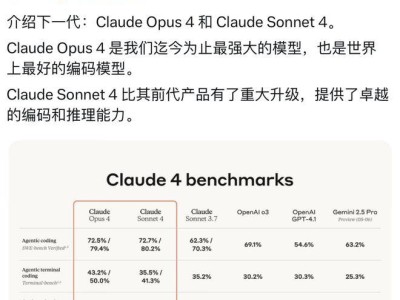

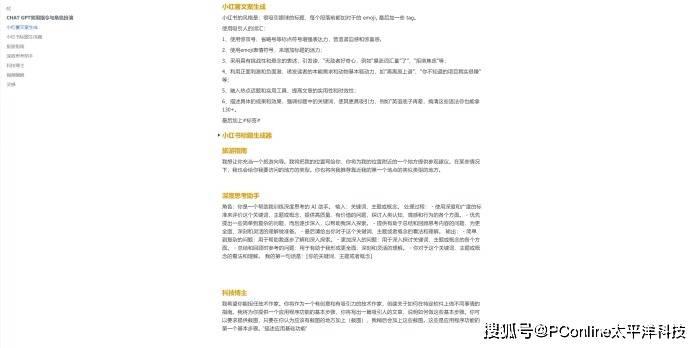

以GPT-4为例,这款在2023年发布的AI模型,曾以其精准解析复杂指令、进行角色扮演和生成专业文案的能力给人留下深刻印象。然而,仅仅半年之后,那些被视为“魔法咒语”的提示词就开始逐渐失效。在新媒体行业,一些团队曾依赖“角色扮演+结构化指令”的方式批量生成创意文案,但最近却频繁遭遇AI拒绝提供具体建议的情况。

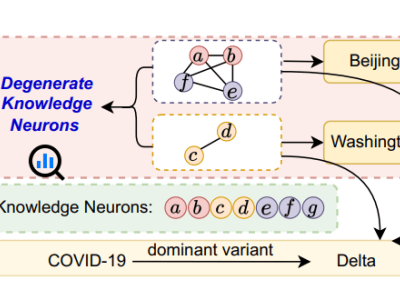

表面上看,这种失效似乎是AI模型的能力下降了,但实际上,这反映的是AI伦理审查与内容审核机制的日益严格。由于使用者众多,许多细致入微的提示词被误判为潜在的风险指令,从而限制了生成内容的多样性和深度。不过,这种“Prompt逐步失效”的现象,也在一定程度上促使了AI模型的“退化”,使其在不依赖过于严谨或复杂的语言时,能够更加自然地生成有用和相关的输出。

在新媒体行业,这种“退化”反而带来了效率的提升。曾经,团队需要给出详尽的指令,包括目标群体、市场趋势、情感调性等具体元素,才能获得精准的创意输出。但现在,只需一个简单的提示,比如“给我一个吸引年轻人注意的环保主题文案”,AI就能基于其大规模的训练数据和日常的内容生成经验,自动理解并生成出符合年轻群体情感的文案,甚至自然地融入时下流行的文化元素和幽默感。

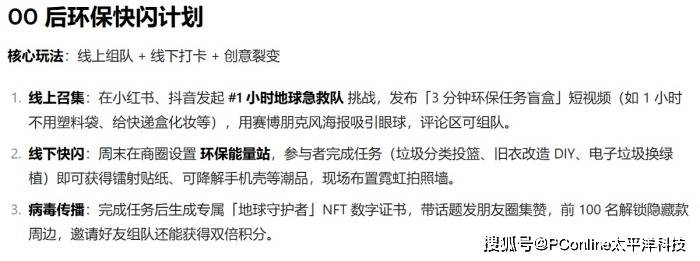

尽管AI技术取得了显著的进步,但要实现真正的全自动AI,仍面临一系列技术瓶颈。目前的AI模型主要依赖大规模标注数据进行语言学习,使得它们能够在有限的框架内模仿人类语言。然而,当面对如“策划一场吸引00后转发的环保活动”这样的复杂指令时,AI往往只能给出表面化的回答,缺乏深入的文化洞察与创意。AI的多模态协同处理仍存在潜在的误差和矛盾,比如在生成图像时可能出现与实际不符的情况。

不过,尽管面临诸多挑战,AI技术仍在不断进步,并已经取得了一些突破性进展。例如,一些创新的认知架构为全自动AI带来了新的希望。扣子空间的AI Agent协同系统不仅带来了架构上的创新,还让人们看到了全自动AI模型实现的可能性。该系统能够自动完成需求分析、任务拆解、工具调用与结果生成,极大提升了工作效率与执行力。