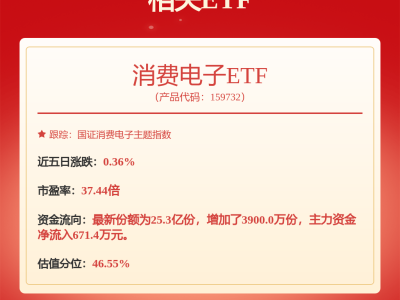

谷歌在2025年I/O开发者大会上宣布了一项重大举措,正式开源了专为医疗领域设计的AI模型——MedGemma。这款模型构建于先进的Gemma3架构之上,具备卓越的多模态图像与文本处理能力,旨在助力医疗诊断与治疗的效率提升。

MedGemma提供了两种不同规模的配置供选择:4B参数模型和27B参数模型。4B参数模型专注于医疗图像的解析,能够精准分类并生成详尽的诊断报告,同时回答与图像紧密相关的问题。而27B参数模型则侧重于临床文本的处理,尤其擅长患者分诊和决策辅助,为医生提供迅速且有价值的患者病情信息,便于制定高效的治疗计划。

4B模型在图像编码方面采用了创新的SigLIP技术,其预训练数据集广泛涵盖了胸部X光、皮肤病学、眼科以及组织病理学等多个医疗领域,展现出在复杂医疗图像处理方面的卓越性能。相比之下,27B模型凭借其庞大的270亿参数,专注于深度解析医疗文本,为临床推理提供有力支持,极大加速了医务人员的决策过程。

为了满足开发者的多样化需求,谷歌提供了灵活的部署选项。开发者既可以在本地运行这些模型进行实验,也可以通过谷歌云的Vertex AI平台将其部署为HTTPS端点,实现大规模应用。谷歌还配备了丰富的资源,如Colab笔记本,以协助开发者进行模型的微调和集成工作。

谷歌积极鼓励开发者针对特定应用场景对MedGemma进行验证和微调,并提供了一系列指导和工具。开发者可以利用提示工程、上下文学习及LoRA等方法,高效地调整模型参数。这不仅使MedGemma成为一款前沿的AI工具,更成为了开发者和医务人员在日常工作中提升效率的强大伙伴。