在2025年的科技舞台上,大语言模型(LLMs)已跃升为人工智能领域的领航力量,对全球科技发展轨迹产生了深远影响。近期,通过对多份研究报告及互联网最新资讯的综合分析,我们对全球及国内顶尖的大语言模型进行了全面剖析,内容涵盖技术框架、性能亮点、存在的局限,以及创业团队如何利用这些模型的便利性。

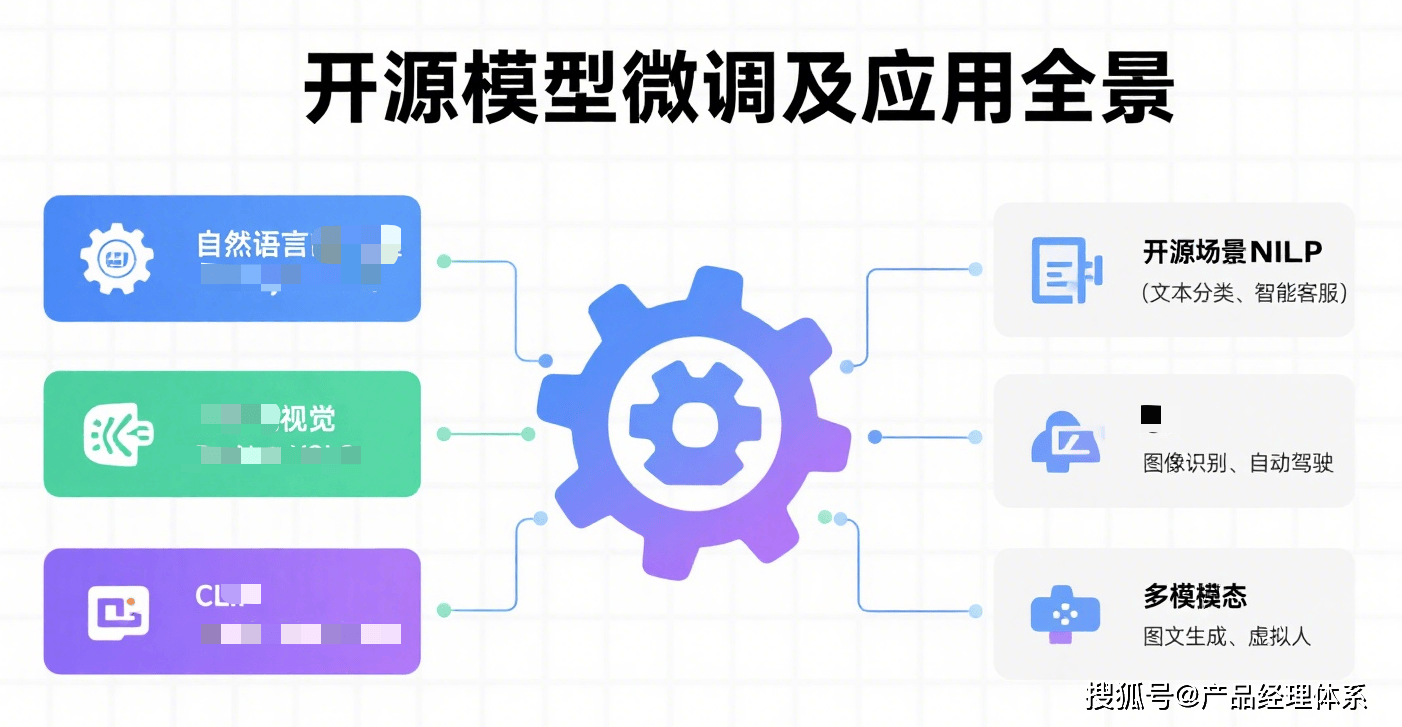

开源模型,凭借其高度的灵活性与可定制特性,已成为企业开发者构建AI应用的优选。在2025年,开源模型的微调策略、多样化的应用场景及实用工具备受瞩目。

微调,作为将预训练模型精准适配特定任务的关键步骤,其过程涉及多个环节与高效工具。Hugging Face Transformers平台,凭借丰富的模型库与专业的微调工具,支持包括Llama、Qwen在内的多种模型,为开发者提供了极大的便利。阿里巴巴的ModelScope平台,则特别擅长于Qwen系列模型的微调,为国内开发者量身定制。而对于追求深度定制的高级用户,PyTorch与TensorFlow这两大深度学习框架,无疑是不可或缺的利器。

实施微调时,首先需根据任务需求精心挑选合适的开源模型,例如DeepSeek-R1在数学领域展现出的卓越能力,或是Llama 4在多模态任务中的广泛应用。随后,收集高质量的行业数据,如金融领域的交易记录或医疗行业的病例资料,成为微调成功的关键。借助GPU或云计算资源,如AWS、Google Cloud的强大算力,进行模型参数的精细调整。最后,经过严格的性能评估,将微调后的模型部署至生产环境,实现其价值。

值得注意的是,微调大型模型,如拥有405B参数的Llama 4,对计算资源的需求极为庞大。为降低这一成本,LoRA(低秩适应)等创新技术应运而生,有效提升了微调效率。

在应用层面,开源模型展现出了广泛的适用性。对话AI领域,基于Llama 4的智能客服与虚拟助手,正逐步改变人机交互方式。内容生成方面,DeepSeek-R1在代码生成上的表现尤为亮眼,自动生成文章、广告文案等也变得轻而易举。数据分析领域,Qwen2.5-Max在处理结构化数据时的自动化报告生成与数据总结能力,为企业决策提供了有力支持。在金融、医疗、法律等垂直行业,开源模型的应用同样展现出巨大潜力,如金融风险评估、医疗诊断辅助、法律合同生成等。

为了助力更多开发者掌握开源模型的应用技巧,一系列实用工具应运而生。Hugging Face平台不仅提供模型下载与微调教程,还拥有一个活跃的开发者社区,为初学者提供了宝贵的学习资源。ModelScope平台则专注于支持国内模型的微调,为国产大模型的推广与应用贡献力量。DeepSeek AI则通过提供DeepSeek-R1的开源模型与详细文档,进一步降低了技术门槛。