阿里巴巴于近日宣布了一项重大开源举措,正式推出了Qwen3-Embedding系列模型,这一系列模型专注于文本表征、检索与排序任务,是基于Qwen3基础模型深度训练而来。

Qwen3-Embedding系列模型在多项基准测试中展现了令人瞩目的性能。据官方数据显示,在MTEB多语言Leaderboard榜单上,该系列的8B参数规模Embedding模型以70.58分的成绩位列榜首,这一成绩不仅超越了众多商业API服务,也彰显了其在多语言文本处理方面的卓越实力。

这一系列模型的特点之一是具备出色的泛化性。在多个下游任务评估中,Qwen3-Embedding系列均达到了行业领先水平。特别是在文本检索场景中,其排序模型能够显著提升搜索结果的相关性,为用户带来更加精准的检索体验。

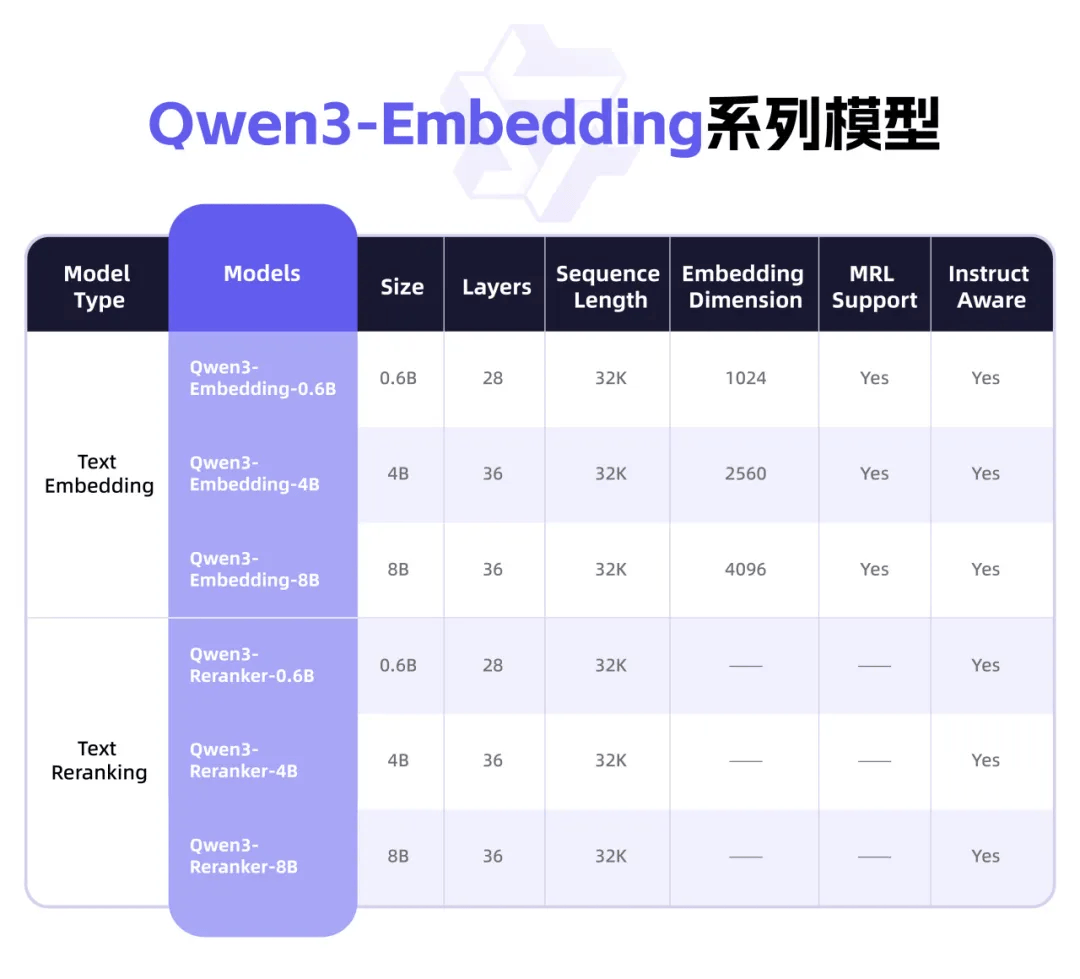

Qwen3-Embedding系列还提供了灵活的模型架构。从0.6B到8B参数规模,该系列提供了三种不同的模型配置,以满足不同场景下的性能与效率需求。开发者可以根据实际需求,灵活组合表征与排序模块,实现功能的定制化扩展。

在定制化特性方面,Qwen3-Embedding系列同样表现出色。它允许用户根据实际需求调整表征维度,有效降低应用成本。同时,该系列还支持用户自定义指令模板,以提升特定任务、语言或场景下的性能表现。这一特性使得Qwen3-Embedding系列能够更好地适应各种复杂的应用场景。

Qwen3-Embedding系列还支持超过100种语言,涵盖主流自然语言及多种编程语言。这一特性使得该系列模型在多语言场景下具备强大的处理能力,无论是多语言文本检索还是跨语言文本匹配,都能表现出色。

在模型使用方面,Embedding模型主要接收单段文本作为输入,通过取模型最后一层“EOS”标记对应的隐藏状态向量,作为输入文本的语义表示。而Reranker模型则接收文本对(如用户查询与候选文档)作为输入,利用单塔结构计算并输出两个文本的相关性得分。这一设计使得Qwen3-Embedding系列在文本检索和排序任务中能够发挥出色的性能。

目前,Qwen3-Embedding系列模型已经正式开源,开发者可以通过ModelScope、Hugging Face以及GitHub等平台获取相关资源和代码。同时,官方还提供了详细的技术报告,帮助开发者更好地理解和使用该系列模型。