阿里巴巴今日震撼发布Qwen3-Coder,这标志着阿里在代码模型领域迈出了历史性的一步,其代理能力堪称业界翘楚。

Qwen3-Coder系列模型规格多样,其中旗舰版本Qwen3-Coder-480B-A35B-Instruct尤为引人注目。这款模型结合了4800亿参数的基础架构与350亿参数的激活MoE机制,天然支持处理256K token的上下文,并通过创新的YaRN技术可扩展至1M token,展现出卓越的代码生成与Agent能力。在Agentic Coding、Agentic Browser-Use及Agentic Tool-Use等多个维度上,Qwen3-Coder-480B-A35B-Instruct均取得了开源模型的顶尖成绩,与Claude Sonnet4比肩而立。

据阿里官方介绍,Qwen3-Coder的引入将极大提升编程效率。即便是编程新手,借助这一工具也能在一天内完成资深程序员一周的工作量。更令人惊叹的是,创建一个品牌官网的全过程仅需5分钟。

同时,阿里还推出了Qwen Code,一款专为代理式编程设计的命令行工具。Qwen Code基于Gemini Code深度定制,通过优化prompt和工具调用协议,最大限度发挥了Qwen3-Coder在Agentic Coding任务中的潜力。Qwen3-Coder还能与Claude Code、Cline等社区内的优秀编程工具无缝对接,进一步拓宽了其应用场景。

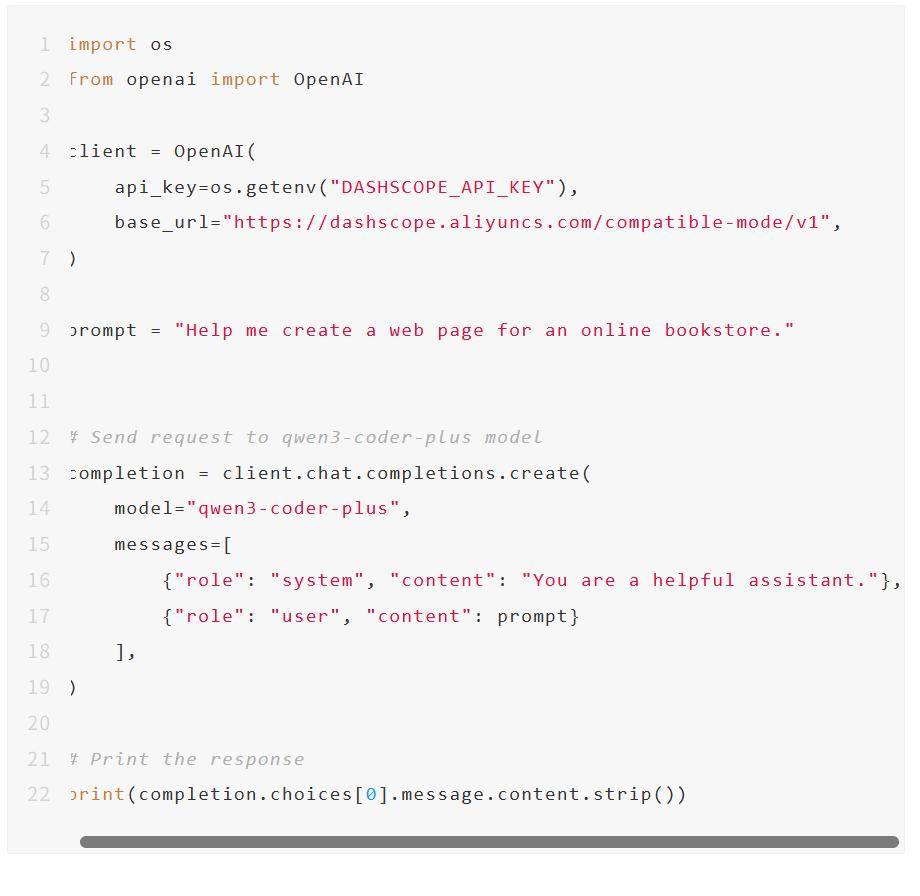

目前,Qwen3-Coder已在阿里云旗下的百炼大模型服务平台上线,其API采用灵活的阶梯计费模式,根据输入token的数量动态调整价格。在256K至1M的区间内,输入价格为每百万token 6美元,输出价格则为每百万token 60美元。相比之下,Claude Sonnet 4的输入输出价格分别为每百万token 3美元和15美元,与Qwen3-Coder在128K至256K区间的价格相当。

为了提升Qwen3-Coder的代码能力,阿里从多个维度进行了全面升级。在数据方面,阿里构建了总计7.5T的庞大数据集,其中代码占比高达70%,确保模型在保持通用与数学能力的同时,具备出色的编程技能。在上下文处理上,Qwen3-Coder原生支持256K的上下文长度,并可通过YaRN技术扩展至1M,专为仓库级和动态数据(如Pull Request)优化。阿里还利用Qwen2.5-Coder对低质数据进行清洗与重写,显著提升了整体数据质量。

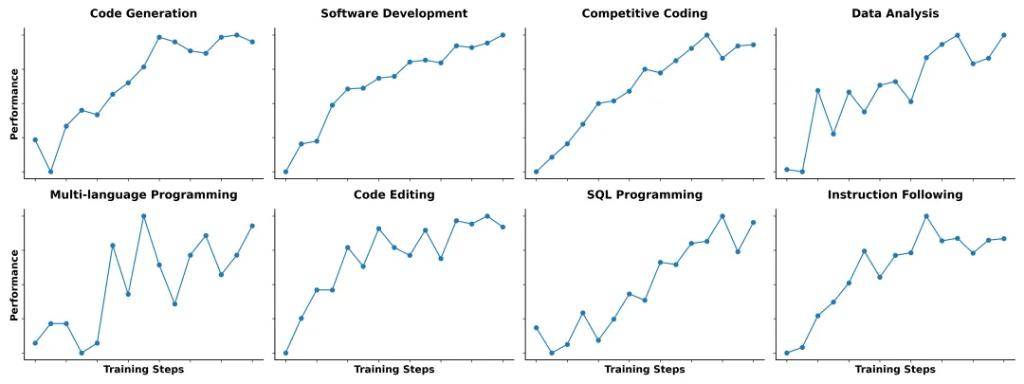

与当前社区普遍关注竞赛类代码生成不同,阿里认为所有代码任务都适合通过执行驱动的大规模强化学习进行优化。因此,阿里在更丰富的真实代码任务上扩展了Code RL训练,并通过自动扩展测试样例,构造了大量高质量的训练实例。这不仅显著提升了代码执行成功率,还对其他任务产生了积极影响。在Long-Horizon RL阶段,模型学会了在真实软件工程环境中进行多轮交互,包括规划、执行、接受反馈和再决策。阿里在Qwen3-Coder的后训练阶段执行了Agent RL,鼓励模型通过多轮交互的方式利用工具解决问题。

在生态集成方面,Qwen3-Coder提供了多元化的使用方案,降低了开发者的接入门槛。自研的Qwen Code工具基于Gemini Code进行优化,通过prompt和工具调用协议的适配,最大化了模型在代理式编程任务上的表现。同时,Qwen3-Coder还支持与Claude Code的集成使用,开发者可通过阿里云百炼平台申请API密钥,实现无缝对接。Qwen3-Coder还兼容Cline等主流编程工具,为开发者提供了丰富的选择。

在正式发布时,Qwen官方还展示了Qwen3-Coder的多个应用案例。例如,让模型设计一个基于物理的烟囱拆除模拟,按照实际需求进行受控爆炸。还有开发者让Qwen3-Coder完成了一个3D HTML开发任务,创建一个3D旋转的立方体展示台,六个面显示不同颜色,自动旋转,并添加了光照效果和阴影等。Qwen3-Coder交付的结果完成度极高,基本实现了所有主要功能,旋转动效、阴影等处理得恰到好处。