在大语言模型的竞争中,数学与代码推理能力已经成为最硬核的“分水岭”。从 OpenAI 最早将 RLHF 引入大模型训练,到 DeepSeek 提出 GRPO 算法,我们见证了强化学习在推理模型领域的巨大潜力。然而,想要复现这些顶尖成果,并不只是“多喂点数据、跑几轮训练”这么简单。现实是,很多中小规模的开源推理模型,在 AIME 这样的高难数学竞赛题、或 LiveCodeBench 这样的复杂代码评测中,依然与闭源 SOTA 存在明显差距。

最近,快手 Klear 语言大模型团队推出了全新的 Klear-Reasoner 模型,基于 Qwen3-8B-Base 打造,在数学与代码的多个权威基准测试中达到同规模模型的 SOTA 水平,并完整公开了训练细节与全流程 pipeline。

论文链接:https://arxiv.org/pdf/2508.07629

Hugging Face:https://huggingface.co/Suu/Klear-Reasoner-8B

GitHub:https://github.com/suu990901/KlearReasoner/tree/main

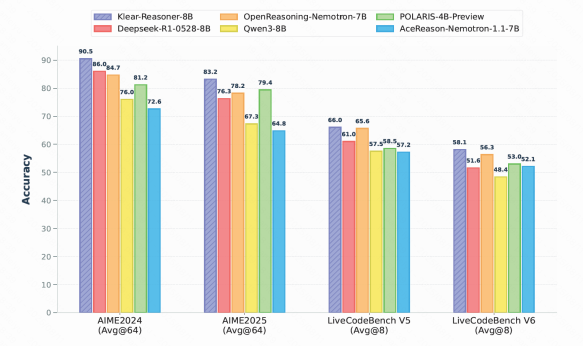

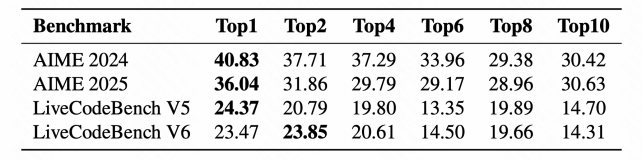

Klear-Reasoner 在 AIME2024、AIME2025、LiveCodeBench V5 和 V6 等基准测试中,不仅全面超越同规模的强力开源模型(包括 DeepSeek 蒸馏版 DeepSeek-R1-0528-8B),更是在 AIME2024 上取得了 90.5%、AIME2025 上取得了 83.2% 的惊人成绩,直接登顶 8B 模型榜首。

在这些成果的背后,最核心的技术创新是Klear团队提出的 GPPO(Gradient-Preserving Clipping Policy Optimization)算法 ——一种在保留训练稳定性的同时,大幅提升探索能力的强化学习优化方法。

在PPO和GRPO等常用的策略优化方法中,clip是控制训练稳定性的重要手段,它通过限制策略更新幅度,避免模型一步走得太远而导致崩溃。Klear团队在实践中发现,clip 机制在保护稳定性的同时,也切断了模型获取最有价值学习信号的通道,模型变得保守,不敢尝试新路径,遇到错误也修正迟缓。

为解决以上问题,Klear团队提出的 GPPO(Gradient-Preserving Clipping Policy Optimization)算法,GPPO的核心思想很直接:不丢弃任何梯度,并且对其进行温和回传。通过 GPPO,推理模型可以在稳定性与探索力之间找到新的平衡点,让它们既敢于尝试,也能迅速纠错。

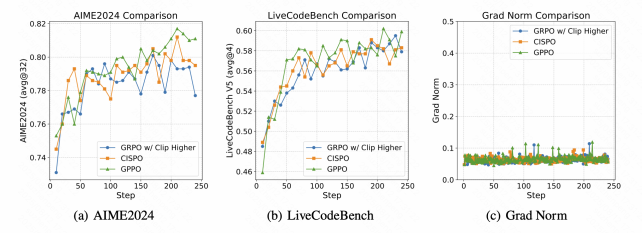

在与现有方法的对比中(包括DAPO的clip-higher以及MiniMax-M1的CISPO方法),GPPO在数学和代码任务上都表现出优势。

数学强化学习训练中GPPO、GRPO(带Clip Higher策略)与CISPO的对比。

除了提出GPPO算法外,Klear团队在论文中对训练流程的多个关键环节进行了深入实验与分析,揭示了长思维链推理模型成功背后的几个核心要素,为社区贡献了一条可复现、可推广的推理模型监督学习和强化学习路线:

实验表明,与数据量大但质量参差的数据源相比,来自少数高质量数据源的样本更具训练效率和效果优势。

高质量数学数据Top-K子集组合对监督微调(SFT)性能的影响。

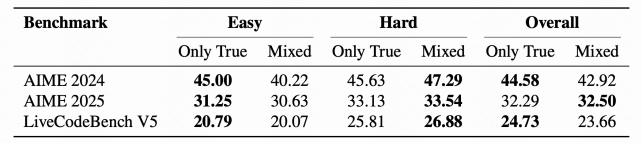

对于简单任务,错误样本的引入会明显影响性能,但对于高难度任务,保留部分带瑕疵的推理路径,反而能够提升模型表现。

通过三组实验分析了数据正确性对模型性能的影响,分别在简单(Easy)、困难(Hard)和整体(Overall)任务集上对比了纯正确数据(Only True)与含错误数据的混合数据(Mixed)的表现差异。表格中加粗数值标识了各组内的最优性能结果。

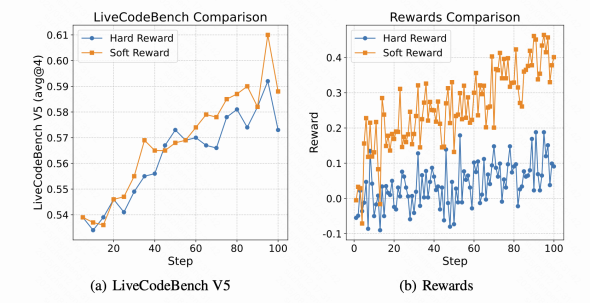

在代码任务的强化学习阶段,使用软奖励(根据通过测试用例的通过率)比硬奖励(完全通过得分,否则为零)更有效

代码强化学习中软奖励与硬奖励策略的对比。在软奖励设置中,奖励值等于测试用例通过率;而在硬奖励设置中,仅当所有测试用例均通过时给予正向奖励,否则给予负向奖励。

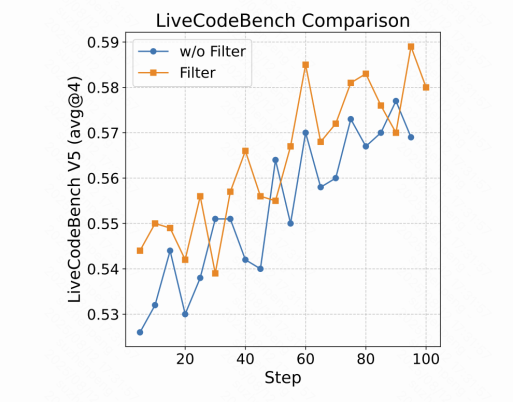

在代码RL数据准备阶段,Klear团队调用DeepSeek-R1-0120为每个prompt生成了16条回复,只有pass@16大于0.5的数据会被保留

在LiveCodeBench V5基准(avg@4指标)上,使用过滤与未过滤数据的代码强化学习性能对比。Filter表示使用过滤数据的强化学习结果,而w/o Filter代表使用原始未过滤数据集的结果。

Klear-Reasoner 的推出,不仅是一份性能亮眼的开源权重,更为社区贡献了一条可复现、可推广的推理模型监督学习和强化学习路线。通过 GPPO,推理模型可以在稳定性与探索力之间找到新的平衡点,让它们既敢于尝试,也能迅速纠错。这对于未来的数学、代码,甚至其他RLVR任务,都有着重要的参考价值。